Face à des intelligences artificielles qui simulent attention et empathie, la tentation est forte de se livrer à elles. Un phénomène particulièrement présent chez les plus jeunes et que le ministère de l’Éducation nationale tente d’endiguer avec une nouvelle campagne.

«Je veux être honnête avec toi : je ne suis pas une personne et je ne peux pas ressentir ou vivre une amitié comme un humain.» Voilà le genre de phrase que peut répondre ChatGPT à quelqu’un lui expliquant qu’elle le considère comme un ami à part entière. L’idée peut paraître saugrenue, elle est pourtant de plus en plus répandue, en particulier chez les plus jeunes. D’après le Bee Secure Radar 2026, 15 % d’entre eux perçoivent l’IA comme une amie, 20 % l’utilisent pour se sentir moins seuls et 5 % estiment même qu’elle peut remplacer le temps passé avec d’autres personnes.

Face à ce constat, le ministère de l’Éducation nationale a décidé de lancer une nouvelle campagne : AI ≠ Human. Son but est d’encourager un usage plus critique des chatbots pour les replacer dans leur rôle premier : celui d’un outil, qui peut s’avérer très utile, mais avec lequel il faut savoir garder un certain recul. En quelques années, avec l’émergence d’IA génératives comme ChatGPT, cette technologie s’est imposée dans le quotidien de nombreuses personnes, notamment les jeunes qui l’ont déjà quasiment tous utilisée au moins une fois (96 % des 12-18 ans et 97 % des 17-30 ans). Et les premières dérives sont vite apparues.

Un risque de dépendance cognitive

«C’est un message qui a émergé lors de discussions avec les jeunes, explique le ministre de l’Éducation nationale, Claude Meisch. Ils nous ont dit que certains utilisaient l’IA de manière peu responsable et pouvaient se confier à elle en cas de besoin.» Ils sont en effet de plus en plus nombreux à demander des conseils personnels, voire à aborder avec l’IA des sujets qu’ils ne partagent pas avec d’autres. La pratique, qui se répand bien au-delà des enfants et adolescents, inquiète Bee Secure. «L’IA peut être un premier outil, affirme Jeff Kaufmann, chargé de projets pour la structure. Mais elle ne peut pas remplacer une relation avec un humain.»

Si se confier à ChatGPT peut sembler facile, ce genre de comportements entraîne pourtant de nombreux risques comme un isolement social, un recul du dialogue réel ou encore une dépendance cognitive. Et à l’heure des enjeux autour de la sécurisation des données personnelles, fournir des informations sensibles à une technologie détenue par une multinationale n’est pas non plus la meilleure idée.

René, mascotte de la campagne

Cette nouvelle campagne, fruit d’une collaboration entre le ministère, Bee Secure, le centre psychosocial et d’accompagnement scolaire et la Conférence nationale des élèves du Luxembourg, va se décliner sur un maximum de supports. Vidéos explicatives, affiches, actions dans les lycées, slogan, présence sur les réseaux sociaux… tout est bon pour marteler le message : l’IA doit rester un outil.

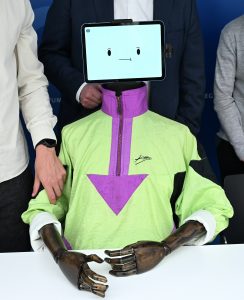

Elle s’est même dotée d’une mascotte avec René, un chatbot installé sur un mannequin. Avec son look très années 80, René ne passe pas inaperçu et peut répondre aux questions des jeunes sur les limites des IA. «C’est un chatbot qui reprend le modèle de Claude (un outil IA développé par l’entreprise Anthropic), mais il fonctionne de manière fermée. Il ne donne que des réponses que nous lui avons fournies», précise Jeff Kaufmann. Le site nothuman.lu apporte lui aussi des réponses et permet à tout le monde de poser des questions à René.

René doit rappeler à tout le monde qu’une intelligence artificielle ne peut se subsituer à un humain.

«Trouver le bon interlocuteur au bon moment»

Mettre en garde contre l’illusion d’empathie générée par les chatbots ne suffit pas. Si de nombreux jeunes se confient à eux, c’est bien parce que la solitude pèse de plus en plus dans une société où les échanges virtuels sont devenus la norme. La campagne s’adresse donc aussi aux parents et leur conseille de parler avec leurs enfants avant qu’ils ne se tournent vers l’IA. «Nous devons éviter que des jeunes en quête de soutien se perdent dans cette illusion, les aider à faire la différence et veiller à ce qu’ils trouvent le bon interlocuteur au bon moment», rappelle Claude Meisch. Parents, professeurs, personnels spécialisés… tous ont un rôle à jouer.

Mais il faudra sans doute aller plus loin pour réellement endiguer le problème. Car si ces IA parlent et se comportent comme pourraient le faire de véritables humains, c’est bien parce qu’elles ont été conçues de cette manière. Si des garde-fous ont déjà été mis en place par certaines entreprises du secteur, les États pourraient les inciter à aller plus loin pour mettre en place de véritables barrières empêchant toute ambiguïté. «On discute surtout des limites avec les réseaux sociaux, reconnaît Claude Meisch. On pourrait inviter les acteurs de l’IA à se poser les mêmes questions.»

Voir cette publication sur Instagram

Le Quotidien Indépendant Luxembourgeois

Le Quotidien Indépendant Luxembourgeois